2023 Google 开发者大会 – AI 领域的技术更新

大会介绍

Google 开发者大会是 Google 面向开发者和科技爱好者展示最新产品和平台的年度盛会。2023 Google 开发者大会 (Google I/O Connect | China) 为开发者提供丰富的学习资源,实践操作和现场演示,提供与谷歌专家互动、与其他开发者交流的契机,助力开发提效,释放团队创造力,简化工作流程,以开放式集成解决方案为开发者效力,共同构建创新生态,开启美好未来。

使用 MediaPipe 轻松实现设备端机器学习

Media Pipe 和设备端机器学习

Media Pipe这是一个用于构建和部署跨平台设备端机器学习解决方案的低代码/无代码框架。它可以将将机器学习集成到你的移动端、Web和物联网应用程序中。

设备端机器学习是机器学习的一种,它可以在用户设备端运行,例如智能手机或网络浏览器,而无需将用户数据发送到服务器处理。

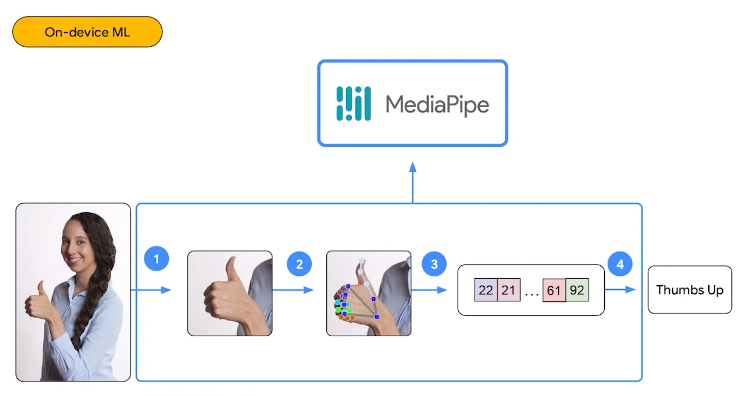

Media Pipe解决手势识别问题

它将图像作为输入并返回图像中找到的手势,如:竖起大拇指。这项任务实际上需要将四种不同的机器学习模型连接在一起:

- ①从图像中检查手

- ②检测手部关键点

- ③创建手势的嵌入向量

- ④将这个嵌入式归类为竖起大拇指

除此之外还能实现很多其他的事情。如:如何在GPU上高效运行整个流程或者不熟在不同的平台上。

但是MediaPipe将这些复杂的工作进行抽象,提供了一个流水线可以为你将模型连接在一起,因此咱们无需费心协调所有这些模型,只需要简单的API交互。

MediaPipe目前支持哪些平台

目前支持Android、Web和Python,很快也会推出IOS支持。

MediaPipe Studio

MediaPipe Studio是一款Web应用程序,可以直接在浏览器中尝试MediaPipe的所有设备端机器学习解决方案,对于手势识别,正在添加双手手势支持,即将落地。MediaPipe Studio还提供了除了手势识别,还有其他有关于机器学习相关的解决方案,如:图像分割、面部识别、文本和音视频解决方案等等。

定制解决方案以适用自己的用例

可以使用MediaPipe Model Maker解决这一问题,MediaPipe Model MakerI从构建之初就旨在成为一个用于定制MediaPipe提供的解决方案的本地库。

以解决手势识别问题为例,步骤如下:

- 收集一个 用手作出石头布和剪刀三种手势的训练数据集

- 获得数据集后就可以开始使用Model Maker训练自定义模型来识别这些手势

- 使用Google Colab的免费GPU更快地训练模型

- 首先你需要导入手势识别器模块

- 然后加载石头剪刀布数据集并开始训练自定义模型

- 可以用模型在训练过程中没有看过的测试数据集来检查模型的准确性

- 最后你可以使用MediaPipe Tasks将其导出以部署在设备上

MediaPipe Studio使我们能在Web浏览器中尝试这些解决方案,以便获得关于将设备端机器学习

集成到应用程序中的灵感,其中许多解决方案都可以使用自己的数据集进行定制 。

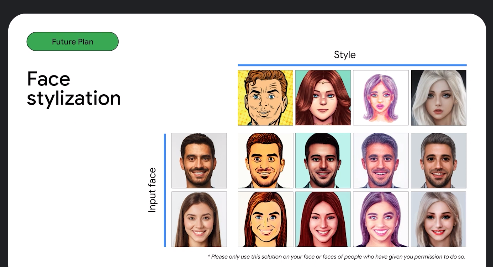

AI模型领域的发展

- 其一是目前发现一种称为模型蒸馏的技术可以用来,将这些通用的大型模型提炼为可以在设备上运行,并专处理一定数量任务的较小模型,推出对图像中的面孔,进行风格化的实验性设备端解决方案,例如你可以使用它将你的照片转换为卡通风格。

- 其二是正在试验的另一个生成式Al模型,是基于扩散的图像生成模型,MediaPipe为我们提供现成的设备端机器学习解决方案,可以将其轻松集成到你的移动或网络应用,在部分的Android手机上已实现在几秒钟内从文本提示生成图像。

- 其三是已能在Android 上部署大语言模型,让它帮助你用自然语言完成一些任务,例如总结一次长对话,或根据给定主题撰写正式电子邮件,虽然设备端生成式Al还处于早期阶段,但在不久的将来会越来越好。

小结

2023 Google 开发者大会给我们展示了许多的技术,Media Pipe将机器学习复杂的工作进行抽象,提供了一个流水线可以帮你将模型连接在一起,开发者可利用该产品套件轻松地将设备端机器学习解决方案集成到不同平台(Android、Web、桌面等)的应用中,同时AI模型已经可以初步部署在Android 上,越来越多的AI模型可以在日常生活中帮助到我们。我们还可以使用自己的训练数据集轻松自定义部分解决方案,只需几行代码即可,在可以在未来我们或许会实现“零代码”!

对MediaPipe、机器学习或者其他开发工具感兴趣的小伙伴,可以前往CSDN专题页,观看 2023 Google 开发者大会主旨演讲和专题演讲的回放视频,了解更多科技新知、前沿案例。CSDN